CCF YOCSEF武汉成功举办技术论坛

“图学习赋能大规模图数据管理与挖掘”

近年来,全球大数据进入加速发展时期,数据量呈现指数级爆发式增长,大量不同个体间彼此交互产生的数据以图的形式表现,抽象出来的图数据构成了研究和商用的基础。传统图数据管理和挖掘的研究已经持续了数十年。深度学习的普及,越来越多图学习相关的研究逐渐大放异彩。因此,如何将图学习应用到大规模图数据的管理和挖掘问题中是一个值得探讨的问题。本次论坛围绕“图学习赋能大规模图数据管理与挖掘”展开,进行了深入的研讨与思辨。

本次活动中,共有3位讲者为我们带来了精彩的报告。首先,袁野教授以“大图数据的极限”为主题带来了一场精彩的报告。报告围绕大图数据的计算极限和表达极限,介绍了包括基于树分解的大图计算模型、基于逻辑表示的图等内容,并对深度学习、逻辑和组合算法等未来工作进行了展望。

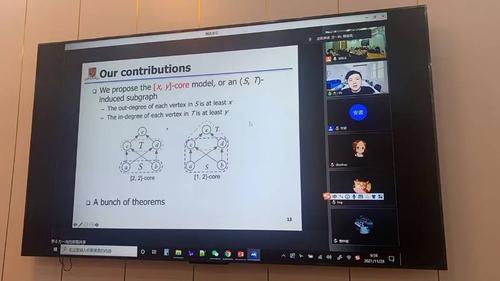

第二位讲者方一向副教授作了题为“面向大规模图数据的稠密子图搜索”的主题报告。方从稠密子图挖掘(理论)、社区搜索(应用)以及图学习(AI for DB)三个方向上介绍了其在大规模图数据上的研究。

最后,郑龙副教授以“图计算加速器设计”为主题带来了第三场精彩报告。报告首先阐述了图形计算带来了独特的挑战,介绍了它在传统体系结构上的效率限制。然后讲述了一套领域特定的图形计算加速器、运行时系统和应用工具。在报告中还提出,除了成对图的情况外,实数图也在迅速发展,在处理更复杂的场景时,高可用性的图形计算应该是足够通用的。

在精彩的学术分享之后,进入思辨环节。本次论坛的思辨主题如下:

1. 传统的图数据管理和挖掘方法是否在大数据时代还适用?

2. 深度学习和图数据挖掘的结合是否大有可为?

3. 图神经网络未来是否会大放光彩?

针对第1个思辨问题,主持人郑渤龙率先发问:“传统图数据挖掘方向是不是已经过时了?”

方一向首先发言:“我认为没有过时。现在基于AI的图网络方法最大的问题就是scalability的问题。从长期的角度来讲,可能存在AI的图神经方法替代的可能性,但现在还是在并行发展的阶段。深度图神经网络的理论研究还有待进一步研究。”

章文接着发言:“我的研究方向主要是生物网络,包括关系实体与对象的关系。在简单经典场景下,使用图神经网络的性能不一定比传统方法要好。在问题导向的具体任务中,针对特定问题,在对性能要求更高的时候,可能简单的传统方法更符合需求。”

郑龙发表自己的观点:“图挖掘会朝着更通用的方式发展。从企业角度,针对特定的业务问题,用传统方法已做到极致,也能够满足企业的需求。但是在当前分布式的时代,对于大图来说,可以采用分布式、高并行的算法,根据需求和计算场景灵活选择。”

主持人继续追问:“大数据时代图数据挖掘方法如何破冰?”

袁野:“深度学习在图像和文字等非结构数据上面具有很大的成功,而在金融、医疗等用关系数据表示的问题中,专家系统能够很好的处理,图神经网络反而没有那么必要。但是随着图的复杂性的增加导致图的结构清晰度降低之后,图神经网络这个时候更容易发挥作用。所以还是需要根据不同领域的需求来适时选择。”

唐厂:“用一些深度学习方法如图神经网络来计算大规模的图数据的时候,可能无法计算。当前用图结构处理和分析大型数据具有挑战,针对特定任务来设计图的结构和图的算法,是今后需要着重研究的问题。”

主持人李琳总结:说过不过时,其实是讨论传统图数据挖掘是否还在研究的主战场上。章文、唐厂等人也都结合具体应用给出了各自的观点。

针对第2个思辨点,渤龙发问:“深度学习和图数据挖掘的结合是否大有可为?图神经网络、神经结构搜索、元学习、自监督学习,哪一个更可能带来深度学习的突破?”

章文首先发言:“我认为图神经网络是首选,自监督对图数据挖掘可增加样本,元学习也能迁移一些东西。”

唐厂发言:“自监督学习其实已经涵盖了前面三个。现在的时代标签获取难度大,而自监督学习可以通过叠代提升网络的学习能力。所以我认为自监督学习能够很好地带来深度学习的突破。”

渤龙又提出:“深度学习在图上的应用和难点应聚焦在何处?”

章文回应:“目前深度学习在大规模图上的算法效率偏低,如果能突破算法对大规模数据的效率,未来可期。”

唐厂:“需要聚焦图神经网络的理论可解释性,这是深度学习在图上应用需要攻克的主要问题。”

针对最后一个思辨点,“图神经网络未来是否会大放光彩?”,主持人提出:“图神经网络可以应用到哪些先进领域?硬件算力优化如何助力图神经网络?”

胡威结合个人研究经历发言:“我以前是做体系结构的。从我研究的角度出发,能否把图神经网络拆出来,切成共通部分和定制化的部分。共通部分用一种通用硬件来计算,改进的、定制化的部分是否有流程化的方法可以转化到硬件上,用硬件直接支持改进。GPU最初其实也是一种定制化的硬件,现在由于并行化等优点逐渐已经变成了通用化的硬件。硬件上是否也能有比较灵活的方式与软件匹配起来,从体系结构的角度来优化。如果图神经网络能拆成共通的部分和个性定制的部分,定制部分考虑转换成流程化的方法再进行硬件实现,则可以实现从体系结构方面去优化,使得硬件可以更好地支撑软件。”

最后,论坛参与嘉宾们进行了总结发言:

袁野:大图的挖掘和处理是我们的未来。

方一向:现在的图神经网络虽然还不能替代传统的图挖掘算法,但也是很好的发展方向。

章文:图学习和生物、健康领域的结合未来可期。

论坛历时三个多小时,通过引导发言、论坛思辨,讨论了图学习大规模数据挖掘领域的主要问题与挑战,探究了相关技术方法与未来展望。通过本次技术论坛,将有利于推动大规模图学习领域的研究,吸引更多学者对该领域进行关注与持续投入。

线上线下与会人员合影